Inteligencia Artificial y el fin de mundo: lo que de verdad está en juego

10.11.2024

Hoy nuestra principal fuente de financiamiento son nuestros socios. ¡ÚNETE a la Comunidad +CIPER!

10.11.2024

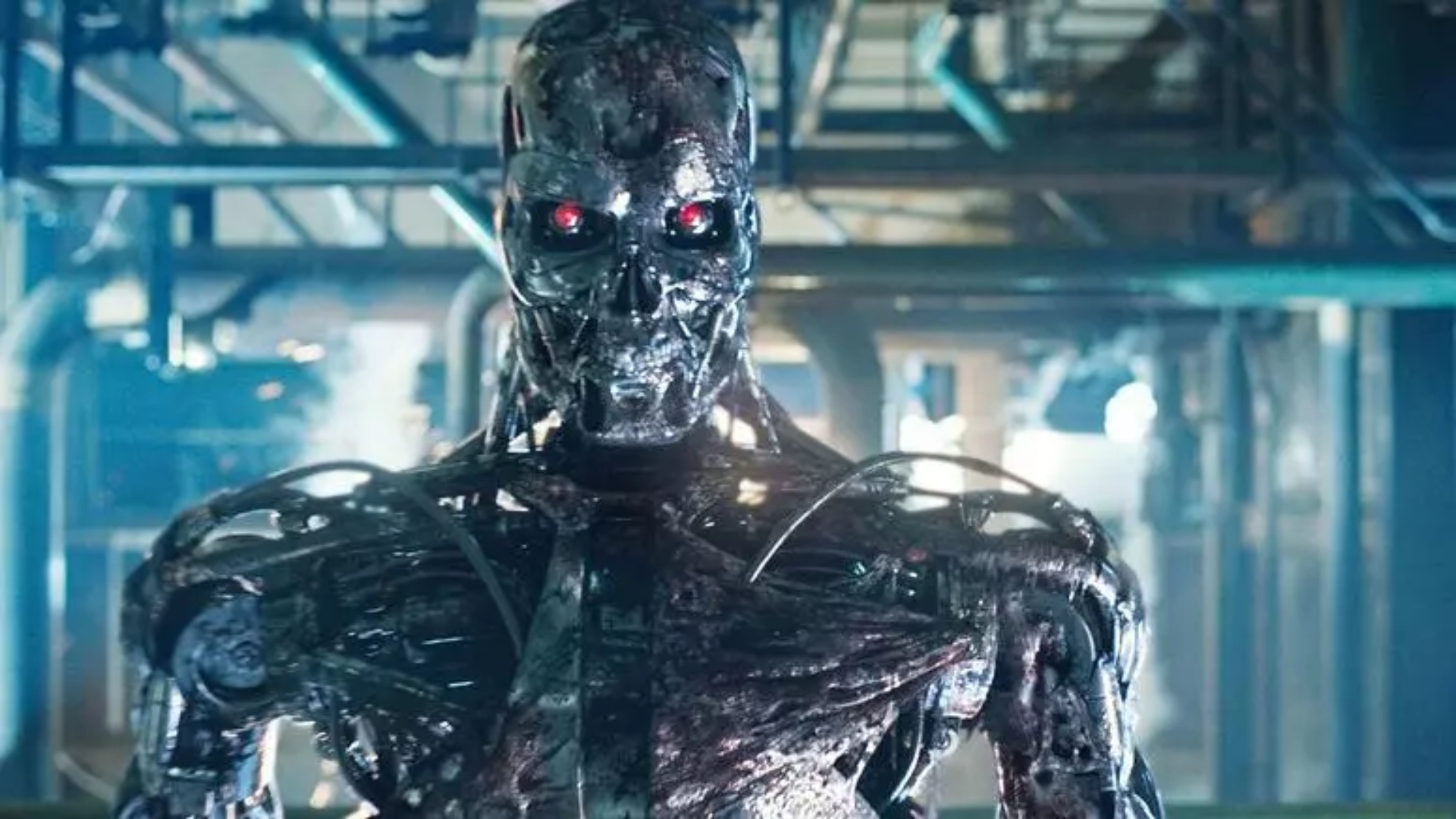

Los límites de la inteligencia artificial (IA) siguen siendo motivo de elucubraciones, profecías apocalípticas y hasta películas. El autor de esta columna reflexiona sobre quienes auguran un futuro distópico sosteniendo que “pensar que la IA puede, desde sí misma, controlar, modificar o destruir el mundo, es darle un poder autónomo que no tiene, y a la vez, quitar responsabilidad a quienes diseñan, desarrollan, controlan y promueven tales sistemas”

Hace algunos días el sociólogo Alfredo Joignant en su “minuto de confianza” del programa Tolerancia Cero expresó su preocupación ante la posibilidad de un cada vez más cercano futuro distópico generado en parte por dos fenómenos distintos pero “convergentes”. Uno de esos fenómenos es la irrupción de la Inteligencia Artificial y el otro es el declive de la población mundial debido a la “reducción mundial del deseo de tener niños”.

En relación al fenómeno de la IA, Joignant señala que “la amenaza es tan inminente que podría estar materializándose ante nuestras propias narices sin que sepamos muy bien cómo esta inteligencia pueda tomar el mando y dejarnos fuera”. Estas expresiones son ejemplos de lo que en inglés se ha denominado “doomerism”, el cual en su forma más extrema promueve la idea de que en algún momento la IA alcanzará conciencia propia y podría aniquilar la humanidad completa.

Es común que ante nuevas tecnologías los pánicos morales y existenciales se apoderen del discurso público y la cultura popular, pero no es tan común que tales ideas hagan eco en académicos o exponentes de las ciencias sociales, aunque como vemos, sí ocurre. Debido a esta razón parece relevante reflexionar sobre el origen, causas y efectos de estos discursos desde un punto de vista racional y sustentado en lo que nos dicen las ciencias sociales.

En primer lugar, la idea de que las “máquinas” tomen el control para “dejarnos fuera” o destruir el mundo sigue siendo ciencia ficción y no hay fuente seria desde los estudios académicos sobre tecnología y sociedad que afirmen algo así. Una visión algo más matizada se encuentran en autores como Yuval Noah Harari, quien ha expresado preocupación por lo que podría ocasionar una “inteligencia no-humana”, que desafía nuestros dominios creativos, amenazando con erosionar el tejido de la interacción humana y la democracia al fomentar una intimidad falsa y la posibilidad de manipular el discurso público. Otra fuente de preocupación con menos intensidad de riesgo existencial, pero preocupante es sobre los efectos de la IA en la destrucción de empleos y el cambio en esferas sociales completas como educación, medicina, derecho, etc.

Sin embargo, todas estas visiones son expresiones de lo que hace varias décadas se ha denominado determinismo tecnológico. Es decir, la idea de que la tecnología determina los procesos sociales como una fuerza autónoma e independiente y con poder causal sobre las estructuras y la agencia personal o colectiva. También hace varias décadas, como respuesta al determinismo, surge la idea de la construcción social de la tecnología, la cual enfatiza que la tecnología no es independiente o autónoma sino producto de decisiones personales y colectivas, contextos sociales, instituciones y condiciones económicas y políticas particulares. Es decir, dejar de pensar en una causalidad unidireccional, lineal y directa sino incluir causalidad inversa o múltiple en la relación entre tecnología y sociedad.

Nada de esto es nuevo, pero los discursos se repiten. Pensar que la IA puede, desde sí misma, controlar, modificar o destruir el mundo, es darle un poder autónomo que no tiene, y a la vez, quitar responsabilidad a quienes diseñan, desarrollan, controlan y promueven tales sistemas. Más aún, es común que los mismos que participan en la creación y mantenimiento de esta tecnología sean quienes promuevan visiones apocalípticas y de riesgo para la humanidad. Y es entendible que así sea, pues por un lado el “doomerism” aumenta el hype en torno a la IA dándole funcionalidades casi místicas y mágicas emanadas de su “peligrosidad”, incrementando así su valoración en el mercado, y por el otro, les permite desprenderse de responsabilidad y accountability al momento de justificar decisiones de desarrollo y sus consecuencias.

A su vez, parte importante de la visión mistificadora de la de IA descansa en el desconocimiento de su funcionamiento y en su grandilocuencia terminológica. Para la académica Kate Crawford, “la IA no es inteligente ni artificial, está hecha de recursos naturales, combustible, trabajo humano, infraestructuras, logística, historias y clasificaciones. Los sistemas de IA no son autónomos, racionales, ni capaces de discernir nada sin conjuntos de datos extensos o reglas predefinidas. […] Debido al capital requerido para construir IA a gran escala y las formas de ver que optimiza, los sistemas de IA están, en última instancia, diseñados para servir a los intereses dominantes existentes”.

De esta manera, la designación Inteligencia Artificial es engañosa, y más aún, construida con fines económicos más que descriptivos. Según uno de los pioneros de la IA, John Macarthy, el término fue elegido para recaudar fondos. En términos estrictos la IA, no “piensa” o “razona”, es un sistema algorítmico, alimentado con una gran cantidad de información, que utiliza la probabilidad, la estadística y el contexto para elegir los resultados que se esperan en función de los datos que ha recibido. De esta manera, también podríamos utilizar términos más precisos como ciencia de datos, algoritmos correlacionales, etc., pero no lo hacemos debido a condiciones muy particulares originadas en la intersección entre agencia particular y estructuras de economía política.

Volviendo a los miedos apocalípticos, una visión menos determinista y anclada en el mundo social nos permite ver que si el mundo se acaba, no será por la IA, sino por las decisiones de personas e instituciones que lo permitieron. Si nuestra democracia es “hackeada”, como dice Harari, no será sólo por la IA sino por las condiciones políticas que lo permitieron. Si se destruyen empleos o áreas económicas enteras será por el tipo de economía-política existente y los actos u omisiones de quienes la diseñaron. Enfocarse sólo en la IA es dejar de hablar de esos contextos, decisiones, regulaciones y diseño de política pública que acompañan y condicionan el desarrollo social.

Pero esto no significa que la IA sea neutra e inofensiva. Nuevamente, sus propiedades no son naturales ni arbitrarias, sino dependientes de su diseño, entrenamiento, datos utilizados, condiciones de desarrollo, etc. Todos las cuales corresponden a acciones humanas, por lo tanto los llamados a regulación (sin caer en visiones apocalípticas deterministas), deben ser escuchados seriamente.

No está de más terminar esta columna recordando que el riesgo existencial planetario sí existe y un futuro distópico es probable, pero por un tema omitido por Joignant en su advertencia: el cambio climático. Hay casi total consenso científico sobre ese peligro para la vida en el planeta y más aún, la creciente energía necesaria para el mantenimiento y crecimiento de los sistemas de IA es un factor cada vez más relevante en el cambio climático. Otra razón más para dejar de lado la ciencia ficción y enfocarnos en lo verdaderamente importante.